Stability AI 宣布推出了 Stable LM 2 12B 模型更新。Stable LM 于 2023 年 4 月作为文本内容大语言模型(LLM)首次推出,并于今年 1 月更新为 Stable LM 2 1.6B 模型。

新的 Stable LM 2 12B 包括一个 120 亿参数的基础版本和一个经过指令调整的变体,使用了七种语言(英语、西班牙语、德语、意大利语、法语、葡萄牙语和荷兰语)的 2 万亿个 token 进行训练。

该公司声称其平衡了强大的性能、效率、内存要求和速度,为开发人员在 AI 语言技术方面的创新提供一个透明而强大的工具。此版本包括对 Stable LM 2 1.6B 的更新,提高了上述所有七种语言的对话技能,并合并了工具使用和函数调用。

公告称,Stable LM 2 12B 被设计为专为多语言任务量身定制的高效开放模型,在广泛可用的硬件上具有流畅的性能。该模型可以处理通常仅适用于较大模型的各种任务,这些任务通常需要大量计算和内存资源,例如混合专家模型 (MoE)。此外,指令调整版本在工具使用和函数调用方面具有高性能,使其非常适合各种用途,包括作为检索 RAG 系统的核心部分。

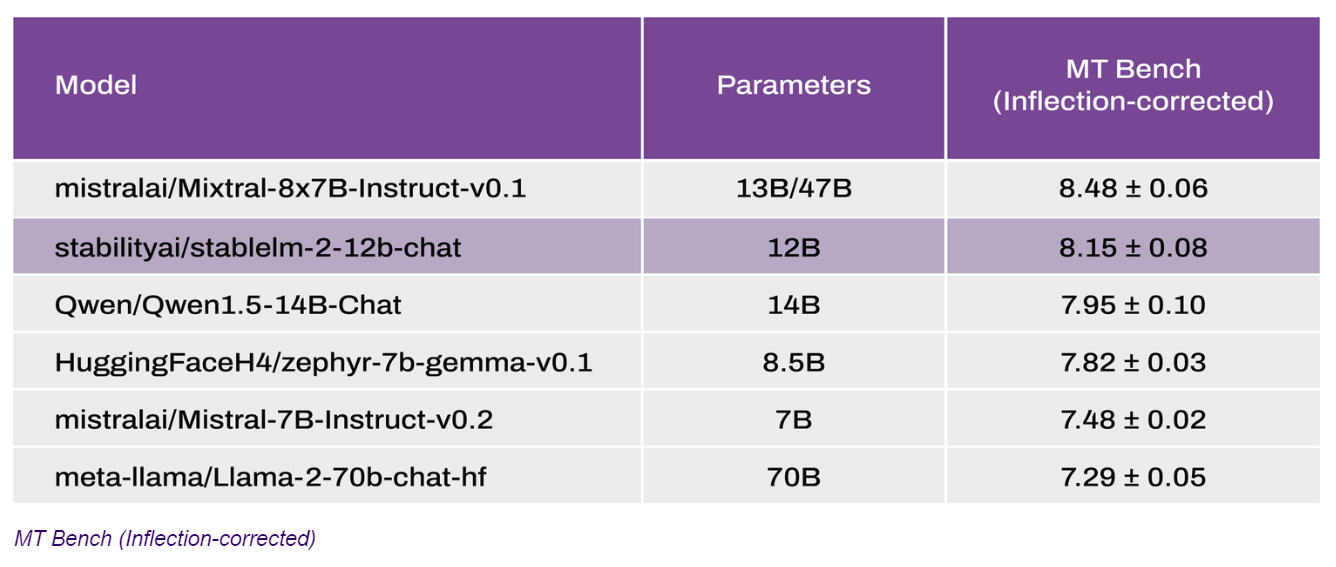

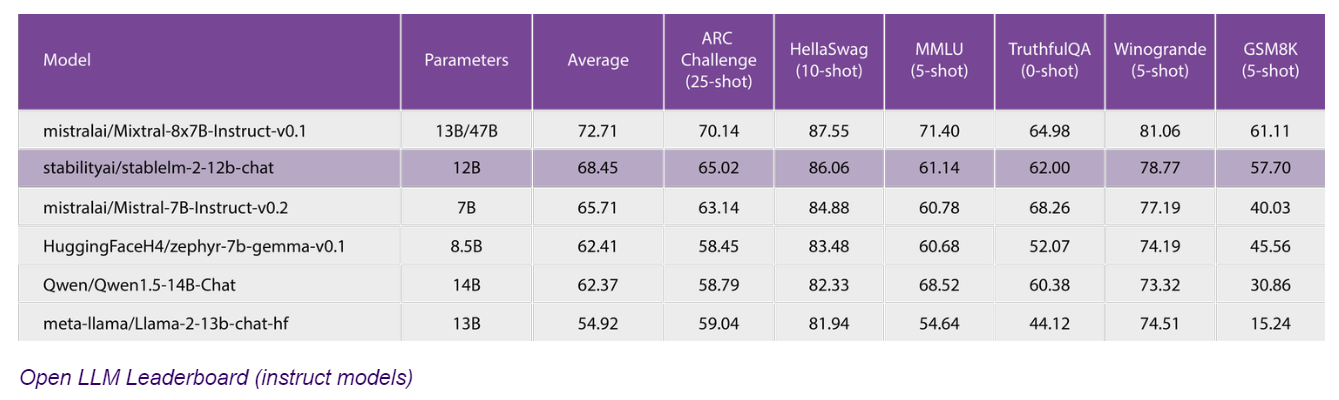

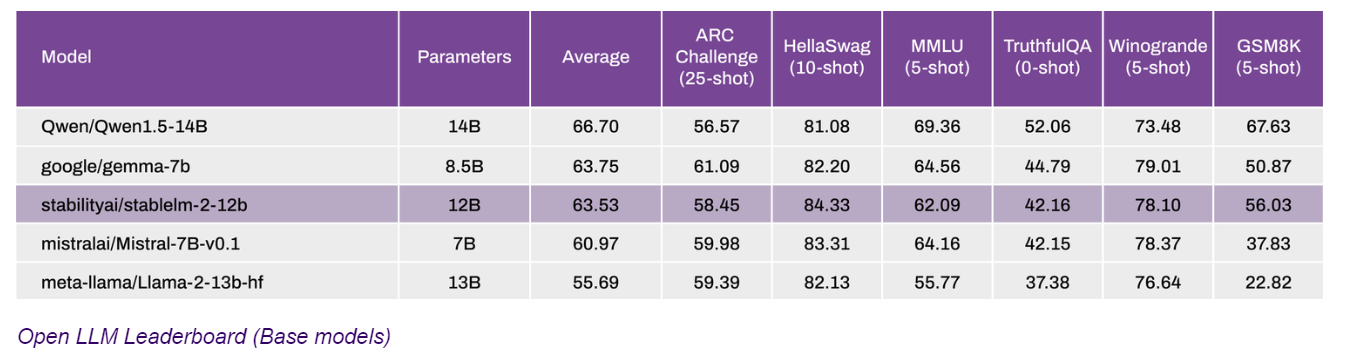

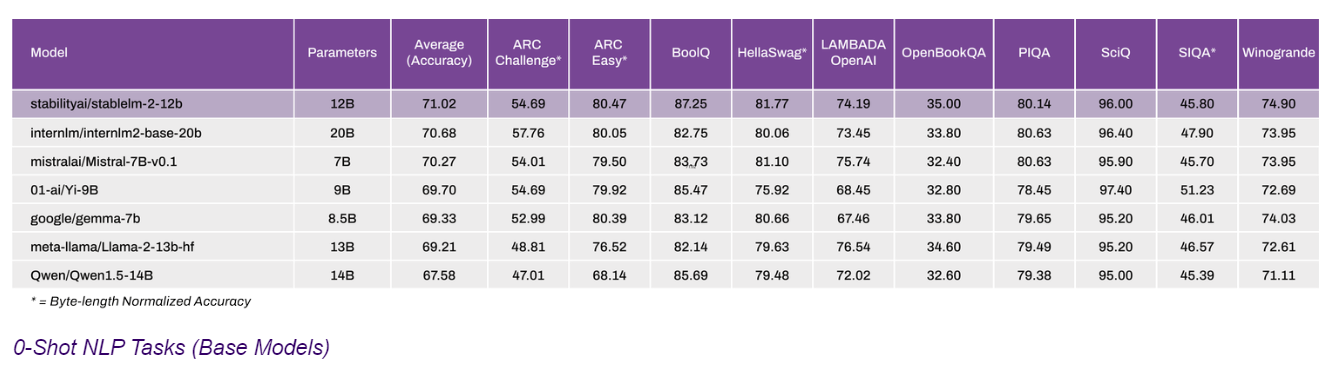

该公司声称 Stable LM 2 12B 在某些基准测试下性能优于 Llama 2 70B 等大模型。

可以在此试用 Stable LM 2 12B,并在 Hugging Face(base & chat) 上进行测试。可通过 Stability AI Membership资格用于商业和非商业目的。

未经允许不得转载:岩猫星空网 » Stability AI 推出 Stable LM 2 12B

岩猫星空网

岩猫星空网