元象发布XVERSE-MoE-A4.2B大模型 ,采用业界最前沿的混合专家模型架构(Mixture of Experts),激活参数4.2B,效果即可媲美13B模型。

该模型全开源,无条件免费商用,让海量中小企业、研究者和开发者可在元象高性能“全家桶”中按需选用,推动低成本部署。

下载XVERSE-MoE-A4.2B大模型

XVERSE-MoE-A4.2B两大优势:

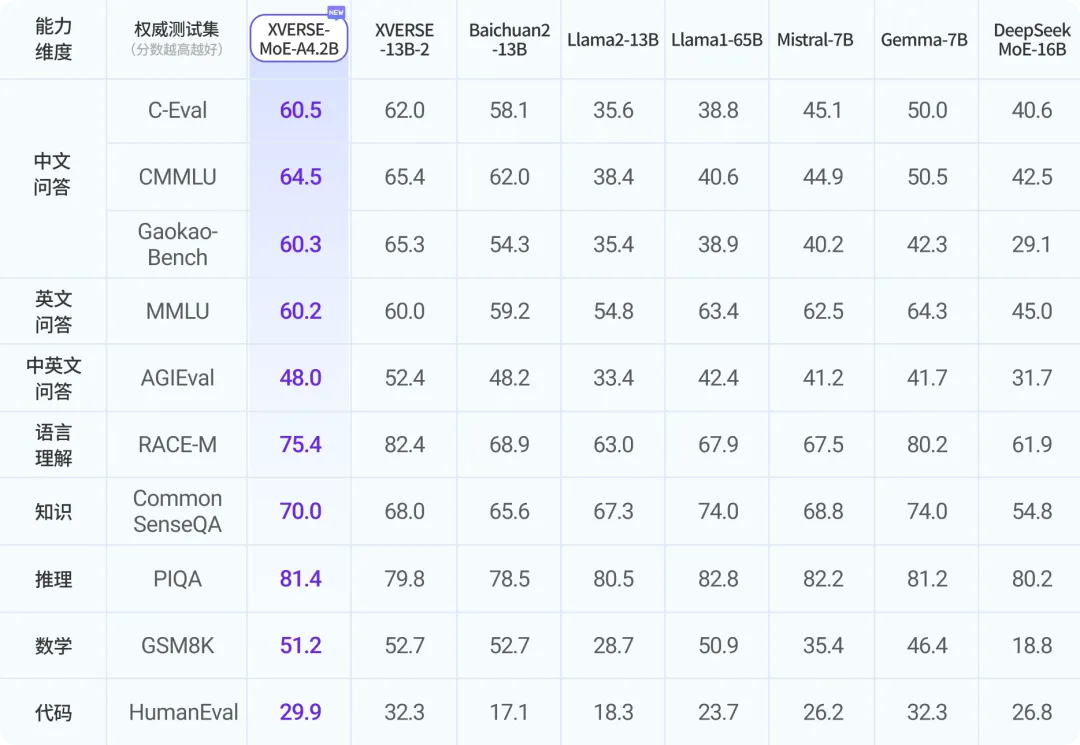

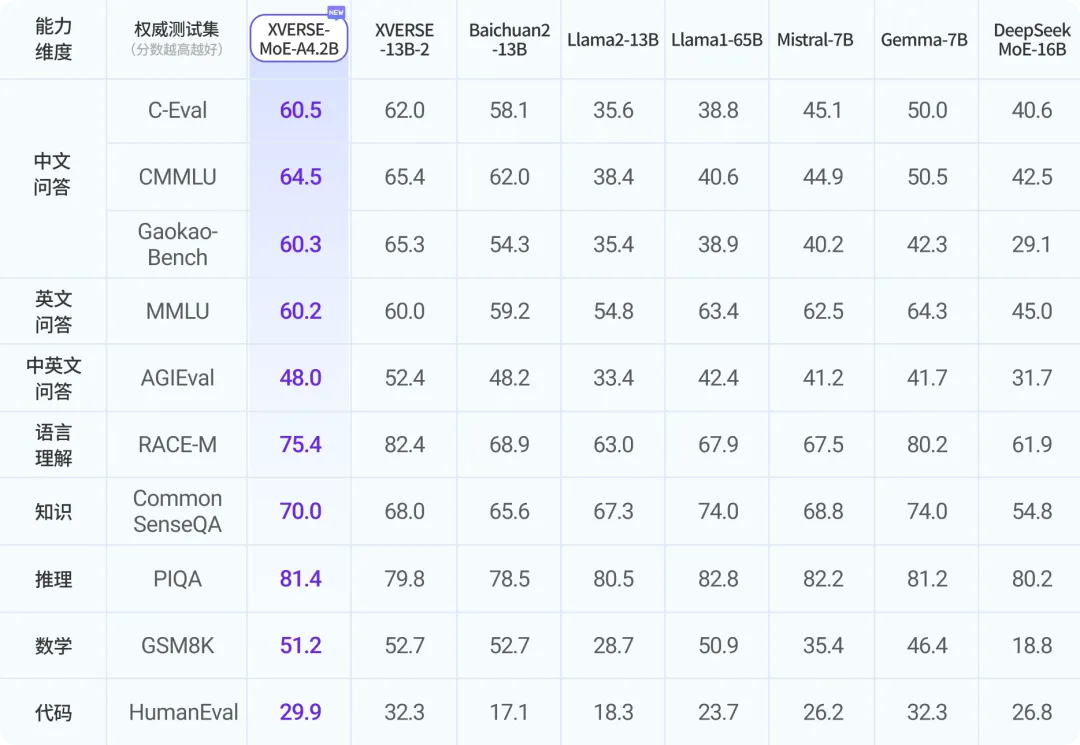

权威测试集评测结果

未经允许不得转载:岩猫星空网 » 元象首个 MoE 大模型开源:无条件免费商用、4.2B 激活参数

元象发布XVERSE-MoE-A4.2B大模型 ,采用业界最前沿的混合专家模型架构(Mixture of Experts),激活参数4.2B,效果即可媲美13B模型。

该模型全开源,无条件免费商用,让海量中小企业、研究者和开发者可在元象高性能“全家桶”中按需选用,推动低成本部署。

下载XVERSE-MoE-A4.2B大模型

XVERSE-MoE-A4.2B两大优势:

权威测试集评测结果

未经允许不得转载:岩猫星空网 » 元象首个 MoE 大模型开源:无条件免费商用、4.2B 激活参数